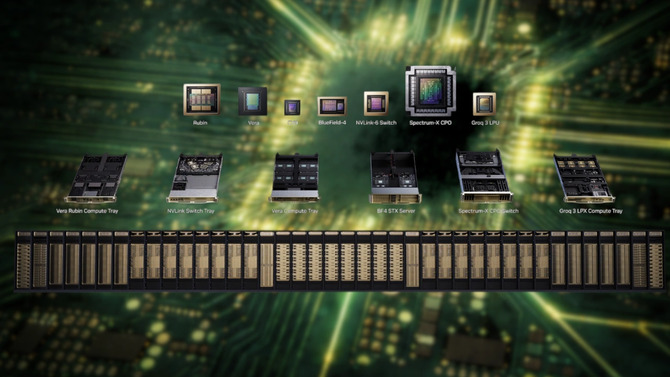

NVIDIA представила платформу Vera Rubin, оснащенную блоками Groq LPU, которые, как ожидается, произведут революцию на рынке искусственного интеллекта

Некоторое время назад в PurePC мы обсуждали вычислительную систему искусственного интеллекта Веры Рубин. Во время мероприятия GTC 2026 NVIDIA объявила о внедрении дополнительных чипов Groq LPX (не путать с моделью LLM Grok от xAI) в свою экосистему искусственного интеллекта. Это решение предназначено для обработки гораздо более длинных контекстов и ускорения процесса вывода в особенно ресурсоемких вычислительных сценариях.

NVIDIA представила платформы Vera Rubin и Vera Rubin Ultra на выставке GTC 2026. Ожидается, что стойки Groq LPX произведут революцию на рынке искусственного интеллекта и в длине контекста, достигнув пропускной способности памяти SRAM 40 ПБ/с.

NVIDIA Роза Фейнман — на GTC 2026 было объявлено, что графические процессоры будут использовать 3D Die-Stacking и специальную память HBM.

Система Vera Rubin, помимо стоек с основными вычислительными серверами на базе GPU и CPU (Vera Rubin Superchip), также включает в себя сетевую инфраструктуру и выделенные стойки Groq LPX. Каждый из них состоит из 32 модулей, каждый из которых оснащен 8 системами Groq 3 LPU. Это означает, что одна стойка Groq LPX объединяет в общей сложности 256 взаимосвязанных LPU. Каждый чип Groq 3 предлагает 500 МБ SRAM (с использованием того же класса архитектуры памяти, что и кэш процессора), пропускную способность памяти 150 ТБ/с и пропускную способность межчиповой связи 2,5 ТБ/с. Стоит подчеркнуть, что весь корпус Groq LPX имеет 128 ГБ SRAM-памяти, обеспечивает пропускную способность связи между чипами 640 ТБ/с и впечатляющую пропускную способность памяти 40 ПБ/с. NVIDIA сообщает, что общая вычислительная мощность искусственного интеллекта в стойке Groq LPX достигает 315 Пфлопс.

NVIDIA DLSS 5 — Компания представляет будущее компьютерной графики на основе использования нейронного рендеринга

Использование памяти SRAM обеспечивает низкую задержку, быструю обработку KV-кэша и ускоряет генерацию токенов, что приводит к 35-кратному увеличению производительности при очень длинных контекстах модели ИИ. LPU работают в гетерогенном конвейере вместе с GPU Vera Rubin, где GPU занимается оперативной обработкой и большими матричными операциями (prefill), а LPU отвечают за последовательную генерацию токенов (декодирование), что обеспечивает высокую энергоэффективность (для таких систем) и низкую задержку даже при миллионах токенов в контексте. Это позволяет системе поддерживать высокий уровень одновременного взаимодействия пользователей для чат-ботов и агентов искусственного интеллекта, а NVIDIA сохраняет свое преимущество над ASIC-микросхемами конкурентов, такими как Cerebras, за счет интеграции лучшего из обоих миров: огромной вычислительной мощности графического процессора и низкой задержки LPU.

Сразу три прорыва Micron: массовое производство HBM4 36 ГБ 12H, SSD Gen6 и SOCAMM2 для платформы NVIDIA Vera Rubin.

Дженсен Хуанг, генеральный директор NVIDIA, представил платформу Vera Rubin Ultra на GTC 2026, представив совершенно новую систему крепления в серверных стойках. Лотки будут вертикальными, а не горизонтальными, что позволит разместить больше графических процессоров в том же объеме и улучшить системы охлаждения. Планируемый Kyber NVL144 позволит разместить 144 графических процессора в одной стойке, а в сочетании с удвоением количества графических процессоров и чипсетов в корпусах он, как ожидается, обеспечит как минимум в четыре раза большую производительность, чем Oberon NVL72 на базе 72 графических процессоров Rubin. Кроме того, стойка Kyber будет оснащена новым коммутатором NVLink 7-го поколения, поддерживающим пропускную способность 3600 ГБ/с, но допускающим поддержку большего количества графических процессоров. Дополнительно система будет оснащена сетевыми картами класса SuperNIC — CX9 1600 G Ethernet, которые ускорят связь всей огромной системы искусственного интеллекта.

Вера Рубин с 1:08:00 / Вера Рубин Ультра с 1:18:00

Источник: NVIDIA