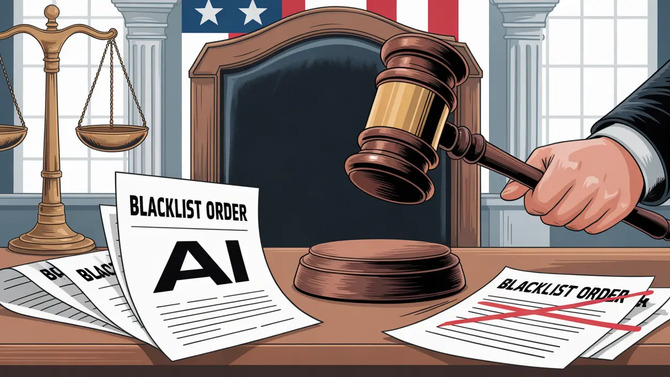

Пентагон хотел одним движением уничтожить Anthropic, занеся компанию в черный список. Суд просто выбил из его рук этот аргумент

Самые интересные битвы вокруг искусственного интеллекта сегодня идут не между моделями, а между людьми и институтами, которые хотят ими управлять. Спор Anthropic с Пентагоном изначально выглядел как очередной спор по поводу условий контракта, но быстро выявил гораздо более серьезную проблему: кто имеет право устанавливать ограничения на использование моделей ИИ, когда дело касается армии, государства и политики. Дело продолжилось в суде.

Это решение не положило конец войне за искусственный интеллект для военных, но оно показывает, что даже Пентагон не может наказать поставщика за то, где он проводит черту.

Предполагалось, что это будет бесплатный кодек для всех, но все закончилось тем, что Dolby Laboratories подала в суд на Snap Inc. o AV1 и HEVC.

Этот спор перестал быть договором, когда стал демонстрацией силы. Судья Рита Лин вынесла предварительный судебный запрет, блокирующий исполнение решений администрации Трампа и Пита Хегсета о внесении Anthropic в черный список и включении компании в список рисков в цепочке поставок, хотя исполнение решения было отложено на семь дней, чтобы правительство могло обратиться за помощью в апелляционном порядке. Суть приговора неудобна для Вашингтона. Суд не увидел здесь убедительных законодательных оснований, а увидел нечто гораздо более простое, а именно попытку наказать компанию за ее публичное противодействие использованию Клода для массовой слежки за гражданами США и полностью автономного оружия.

Мета заявила, что некоторых рисков избежать невозможно. Присяжные только что выставили ей очень дорогой счет.

Для обычного пользователя Клод на данный момент является скорее сигналом, чем шоком, поскольку коммерческий и потребительский доступ не был центром этого конфликта. Гораздо важнее то, что происходит этажом выше. Anthropic пытается навязать государству не только цену и условия лицензии, но и ограничения на использование модели. По сравнению с OpenAI, Google или xAI, это гораздо более резкий шаг, потому что конкуренты охотнее играют с прагматизмом, а Anthropic продаёт осторожность как часть продукта. Для рынка это очень четкий тест. Может ли компания, занимающаяся искусственным интеллектом, рассказать госзаказчику не все и не везде?

Несколько записей и миллиарды долларов на столе. Илон Маск только что получил счет за хаос вокруг Твиттера

Мы уже возвращались к более раннему этапу этой истории и еще раньше к дебатам REAIM об ответственном использовании ИИ в вооруженных силах. Сегодняшнее решение хорошо объединяет обе темы. Военный искусственный интеллект больше не является исключительно вопросом производительности модели, он становится спором об ответственности, конституционных пределах давления и власти государства по отношению к частным поставщикам. Если приказ выдержит апелляцию, у компаний появится веский аргумент в пользу защиты собственных ограничений безопасности, не опасаясь политического возмездия. Если это потерпит неудачу, отрасль получит холодное сообщение о том, что, столкнувшись с государственным контрактом, этика продукта может легко оказаться дополнением, а не принципом.

Источник: Reuters, BBC News, CBS News, Anthropic, Justia.