Спорные правила использования антропного. Администрация США критикует ограничения ИИ в службах безопасности

Реализация передовых моделей ИИ в таких чувствительных областях, как национальная безопасность и правоохранительные органы, приводит к неизбежной напряженности. Технологические компании, которые создают эти мощные инструменты, все больше сталкиваются с дилеммой того, как согласовать коммерческий потенциал своих продуктов с этической ответственностью за их использование. Растущие различия в предложениях между создателями и государственными учреждениями ознаменовывают новую эру регулирующих споров.

Спор между антропным и Белым домом подчеркивает растущий конфликт между этическими рамками создателей искусственного интеллекта и стремлением к использованию этой технологии.

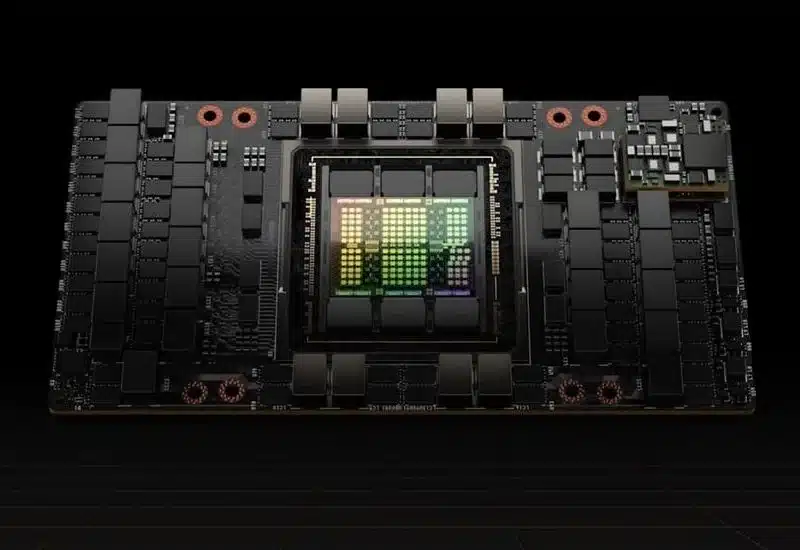

Пентагон вручает контракты на 200 миллионов долларов на XAI, Google, Opeli и Anpropic для развития ИИ для армии

Антропик оказался в Центре политических штормов в Вашингтоне после того, как отказался предоставить свои модели AI Claude для целей, связанных с национальным надзором. Согласно отчетам Портала Семфора, компания отклонила заявки от подрядчиков, сотрудничающих с федеральным законом, конфликт напрямую влияет на такие организации, как ФБР, секретная служба и иммиграционная и таможенная соблюдение, где надзор является основным элементом повседневной работы. Два высокопоставленных чиновника Белого дома выразили опасения, что антропс может выборочно применять свои принципы на основе политических предпочтений, используя неясную формулировку, которая позволяет широко интерпретировать ограничения. Проблема приобретает особое значение в контексте того факта, что модели Claude являются единственными расширенными системами ИИ, которые могут работать с самыми высокими секретными материалами через Amazon Web Services GovCloud.

Антрическое гигантское урегулирование отвергнуто судьей. 1,5 миллиарда долларов США может быть недостаточно для авторов книг, используемых ИИ

Правила использования антропной характеризуются четким контрастом с подходом конкурентных компаний. OpenAI в своих руководящих принципах запрещает «несанкционированный надзор», оставляя пространство для судебных действий правоохранительных органов. Между тем, антропная политика категорически исключает «национальный надзор» без точного определения этого термина в контексте служб безопасности. Компания предлагает свои услуги государственным учреждениям для символического доллара и сотрудничает с Пентагоном, одновременно запрещает использование своих технологий для разработки оружия. Ситуация показывает растущую напряженность между этикой ИИ и потребностями национальной безопасности в эпоху Трампа. Администрация ожидает от американских технологических компаний патриотической поддержки в глобальной конкуренции искусственного интеллекта, особенно в конфронтации с Китаем. Поэтому антропический должен сбалансировать между коммерческими целями и собственными этическими стандартами.

https://www.youtube.com/watch?v=fgKnuvvvnc

Источник: семафор, антроп, декодер