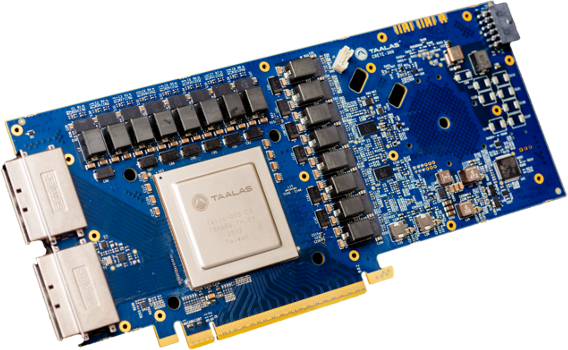

Стартап Taalas HC1 вписывает модели искусственного интеллекта непосредственно в кремний. 16 000 токенов в секунду и стоимость в десять раз ниже, чем у GPU

Канадский стартап Taalas вышел из укрытия и предложил радикальный подход к ускорению искусственного интеллекта. Вместо того, чтобы создавать еще одну гибкую вычислительную платформу, компания буквально впечатала параметры языковых моделей в структуру кремниевого чипа. Эффект? более 16 000 токенов в секунду для Llama 3.1 8B. Это в десять раз больше, чем у самых мощных конкурирующих систем, при этом сокращая эксплуатационные расходы в десять раз.

Стартап Taalas добился десятикратного преимущества перед конкурирующими графическими процессорами в области вывода ИИ, закодировав всю нейронную модель на чипе, но ценой этой революции является полная потеря гибкости.

Европейский Союз создает инфраструктуру для внедрения искусственного интеллекта. Начинается форум экспертов Frontier AI

Канадский стартап Taalas, основанный всего два с половиной года назад ветеранами AMD и Tenstorrent, включая Любишу Баич, уже привлек финансирование в размере 219 миллионов долларов и представил работающий прототип HC. Это чип, который выводит концепцию ASIC для искусственного интеллекта на совершенно новый уровень специализации. Параметры модели и ее веса сохраняются в ПЗУ (постоянной памяти), интегрированном непосредственно в структуру полупроводников, производимых TSMC по 6-нм техпроцессу. Архитектура сочетает в себе эту неизменяемую структуру нейронной сети с блоками SRAM для поддержки динамических операций, таких как кэш KV и тонкая настройка с помощью адаптеров LoRA. Результат впечатляющий. Один чип площадью 815 мм² и 53 миллиарда транзисторов вместил в себя всю 8-миллиардную модель Llama 3.1, достигнув в тестах от 14 000 до 17 000. токенов в секунду на пользователя. Текущий лидер, Cerebras с архитектурой WSE, едва превышает 2000 токенов/с, а графический процессор NVIDIA Blackwell B200 колеблется в районе 350 токенов/с.

OpenAI запускает GPT-5.3-Codex-Spark на чипах Cerebras WSE-3. Это первая реализация за пределами экосистемы NVIDIA.

В основе этой производительности лежит устранение перегородки памяти, от которой страдают традиционные графические процессоры и XPU. Вместо передачи гигабайт весов из памяти HBM в вычислительные блоки, Taalas выполняет умножения непосредственно там, где хранятся параметры. Компания утверждает, что одного транзистора достаточно для хранения 4-битного веса и выполнения соответствующего умножения. Это доводит плотность до уровня, недостижимого для программируемых платформ. Система потребляет всего 200 Вт, что при десяти картах HC1 в сервере означает всего 2,5 кВт общего энергопотребления, что в сорок раз меньше, чем комплект графических процессоров, требующий 120-600 кВт и жидкостное охлаждение. Экономика TCO (общая стоимость владения) также в пользу Тааласа. Стоимость миллиона токенов для Llama 3.1 8B составляет 0,75 цента, а для GPU достигает 3,79-28,6 цента в зависимости от оптимизации. Даже принимая во внимание стоимость трех отключений ленты за четырехлетний срок службы системы (по сравнению с одним обновлением графического процессора), разница остается огромной.

Intel впервые представила прототип памяти ZAM, которая призвана составить конкуренцию памяти HBM на рынке искусственного интеллекта

Но, как и любая специальность, Таалас платит огромную цену за свои достижения. Это полное отсутствие гибкости. Каждый чип работает только с одной конкретной моделью. Переход с Llama 3.1 на Llama 4 требует перепроектирования двух слоев маски и повторного производства в TSMC, что компания обещает завершить за два месяца. Для более крупных моделей, таких как DeepSeek R1 стоимостью 671 млрд злотых, необходимо использовать около 30 отдельных систем, объединенных в кластер (каждая из которых оптимизирована под отдельную часть модели), что на практике означает необходимость проведения 30 этапов подготовки проекта к производству (так называемые инкрементные ленты). Это совершенно другая философия, чем у универсальных графических процессоров, которые NVIDIA продает Meta, Google и Microsoft. Вот почему всего через несколько дней после объявления Taalas Meta подписала с NVIDIA «многопоколенческую» сделку на миллиарды долларов, тем самым проигнорировав доступность HC1. Созрел ли рынок ИИ для такой специализации? Таалас предполагает, что клиенты готовы использовать конкретную модель в течение года или более, особенно по мере увеличения цикла обновлений для пограничных LLM (GPT-5.3 или Llama 4 появляются каждые 12–18 месяцев, а не ежеквартально). Если хотя бы несколько крупных центров обработки данных решат сделать этот шаг, они сэкономят 60–75 процентов капитальных затрат при самом быстром выводе в мире. Это может положить начало новой эре сверхспециализированных ускорителей. В противном случае HC1 останется просто увлекательным технологическим экспериментом, показавшим, что находится на самой крайней точке компромисса между гибкостью и производительностью.

Источник: Таалас, Forbes, Reuters, EE Times.