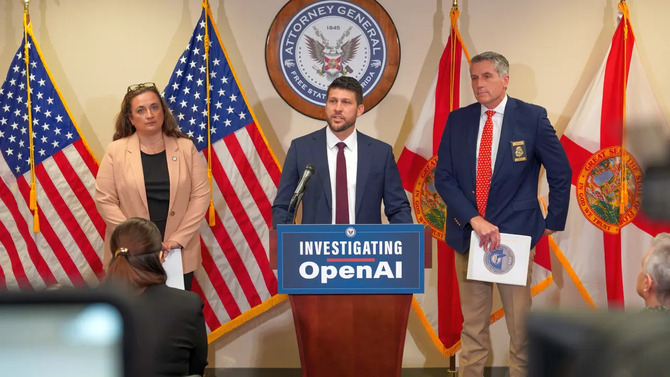

Если бы это был человек, ему бы предъявили обвинение. Флорида атакует OpenAI после разговоров злоумышленника с ChatGPT

Один и тот же вопрос уже несколько месяцев крутится вокруг генеративного искусственного интеллекта, а именно, где заканчивается инструмент и начинается ответственность его создателя. Теперь этот спор переходит из совещаний и залов суда прямо в уголовное расследование. Флорида проверяет, были ли разговоры исполнителя атаки на Университет штата Флорида с ChatGPT всего лишь цифровым эхом Интернета или реальным элементом подготовки к совершению преступления.

Возможно, это тот момент, когда индустрия искусственного интеллекта потеряет удобное оправдание того, что чат-бот — это всего лишь отражение того, что уже есть в сети.

Архив Анны с решением суда на 322,2 млн долларов США. Spotify и крупные лейблы победили, но проблема не исчезла

Флорида не делает полумер. Прокуратура штата возбудила уголовное дело против OpenAI после предварительного анализа логов, из которых видно, что виновник стрельбы в Университете штата Флорида спрашивал ChatGPT, помимо прочего, об оружии, боеприпасах и моменте, когда в центре кампуса будет больше всего людей. OpenAI холодно отвечает, что чат-бот не призывал к насилию, а лишь предоставлял общедоступную информацию. Проблема в том, что собственная политика компании прямо запрещает использование сервисов для насилия и получения знаний об оружии, поэтому расследование атакует не только саму модель, но и то, сработали ли механизмы обнаружения угроз тогда, когда они должны были сработать.

Инвесторы требуют данные о воде и электричестве от гиперскейлеров. ИИ открывает новый фронт в спорах о центрах обработки данных

Для обычного пользователя эта история имеет очень практическое измерение. Если государство начнет рассматривать подобные случаи как проверку ответственности производителя, платформы искусственного интеллекта будут реагировать более жестко, обеспечивая более строгую фильтрацию вызовов, больший контроль над сигналами угроз и большую готовность обращаться в правоохранительные органы. Читатели PurePC уже видели это направление в статьях о памяти ChatGPT, споре о конфиденциальности разговоров и тестировании проверки возраста. Теперь эти нити сливаются в одно целое. Безопасность будет осуществляться за счет анонимности и свободы использования модели.

Пентагон хотел одним движением уничтожить Anthropic, занеся компанию в черный список. Суд просто выбил из его рук этот аргумент

По сравнению с конкурентами, OpenAI сегодня выглядит не исключением, а, скорее, первой большой целью. NPR напоминает, что подобные обвинения коснулись и Google Gemini, так что речь идет уже не об одной компании, а обо всем рынке. Долгосрочный эффект может быть простым. Меньше веры в саморегулирование, больше проверок, больше обязательств по отчетности и более консервативные модели. С точки зрения пользователя это означает инструменты, менее подверженные риску. С точки зрения отрасли, это означает конец удобного повествования о том, что ответственность всегда лежит исключительно на человеке, сидящем за клавиатурой.

Источник: NPR, NBC News, Генеральная прокуратура Флориды.