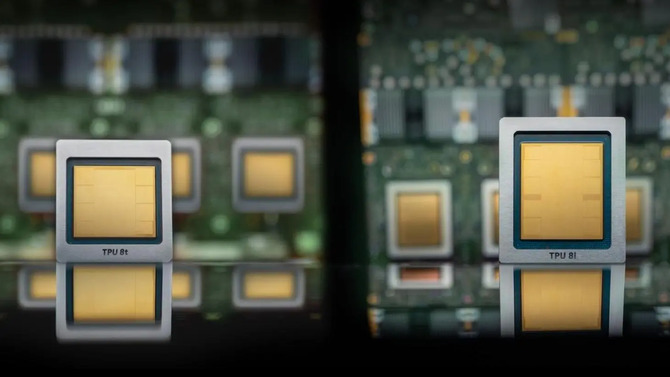

Google показывает TPU 8t и TPU 8i. Новое поколение систем обеспечивает отдельные пути для обучения модели и вывода.

Google снова закручивает гайки в гонке за инфраструктуру для искусственного интеллекта, но на этот раз речь идет не о простом увеличении мощности. Компания показывает, что рынок дорос до того, что одного ускорителя уже не хватает для всего. За маркетинговым лозунгом об эпохе агентов стоит гораздо более приземленная проблема: стоимость ответа, задержка и масштаб, которые начинают съедать бюджеты центров обработки данных.

Google не просто демонстрирует более быстрый TPU, но признает, что модели обучения и обслуживание готовых агентов — это сегодня два разных бизнеса.

AMD Ryzen 9 9950X3D2 Dual Edition — Жесткие тесты и странная политика производителя. Что случилось снова?

Google продает премьеру TPU 8t и TPU 8i со слоганом Agentic Era, но суть этого анонса гораздо интереснее слогана. Впервые компания четко разделяет обучающее оборудование и оборудование для вывода. TPU 8t призван сократить время обучения крупных моделей, поэтому Google говорит о суперподе с 9600 чипами, 2 ПБ общей HBM-памяти и 121 EFLOPS вычислительной мощности. В свою очередь, TPU 8i имеет совершенно другой профиль, то есть 288 ГБ HBM, целых 384 МБ SRAM на чипе и дизайн, ориентированный на низкую задержку, длинный контекст и поддержку нескольких агентов одновременно. Другими словами, Google перестал делать вид, что обучение и предоставление ответов — это одна и та же проблема, но в разных пакетах.

Intel ARC G3 и Intel ARC G3 Extreme должны дебютировать на выставке Computex 2026. Процессоры Panther Lake для карманных компьютеров

Для конечного пользователя это не означает внезапное удешевление подписки на ИИ в одночасье, но в долгосрочной перспективе это может привести к более быстрому реагированию, большей доступности услуг и снижению стоимости одного запроса в облаке. Это тема, к которой мы вернулись с Ironwood, а позже и с текстами о Microsoft Azure Maia 200 и Groq LPU. Рынок все больше делится на системы для тяжелых тренировок, а также на системы для быстрого и дешевого вывода ИИ. У Google здесь веский аргумент, ведь она продает не только кремний, но и весь стек, включая собственный TPU, процессоры Google Axion, сеть и программное обеспечение для JAX, PyTorch или vLLM.

Чипы Tesla AI6 и AI6.5 производства только в США. Samsung Foundry и TSMC получают разные роли в плане Маска

Однако по сравнению с конкурентами ситуация сложнее, чем предполагают слайды конференции. NVIDIA по-прежнему удерживает экосистему, инструменты и позиции на рынке, а Google также хочет предложить платформы NVIDIA в своем облаке. Microsoft с Maia 200 также стремится улучшить экономику вывода, и Грок уже давно показал, что специализированная система может победить там, где имеет значение время отклика, а не универсальность. Разница в том, что Google сегодня имеет смелость назвать это подразделение напрямую и подчинить ему всю архитектуру. Если эта тенденция сохранится, графические процессоры станут королем общих задач и обучающей части, а специализированные ASIC будут все быстрее и быстрее отнимать у них логические выводы. Это важнее, чем премьера двух новых TPU, ведь именно здесь решится борьба за самый дешевый токен в облаке.

Источник: блог Google, блог Google Cloud, CNBC.